Klimamodelle sind so treffsicher wie nie – doch jetzt hakt es an den Daten

Klimamodelle liefern heute sehr präzise Ergebnisse. Eine neue Studie zeigt: Die größte Unsicherheit entsteht inzwischen durch Messdaten.

Selbst ältere Klimamodelle schneiden teils besser ab als erwartet und liegen nah an heutigen Spitzenmodellen. © Unsplash

Klimamodelle entscheiden heute mit darüber, wie Städte gebaut werden, wie teuer Versicherungen sind und wie sich Länder auf Hitzewellen vorbereiten. Lange gab es Zweifel daran, wie verlässlich diese Berechnungen wirklich sind. Eine neue Studie im Nature-Fachjournal Communications Earth & Environment liefert dazu eine klare und zugleich unerwartete Einordnung. Die Modelle arbeiten inzwischen deutlich präziser als oft angenommen. Die größte Schwäche liegt heute an anderer Stelle.

Für die Analyse griff das Team um den Physiker Dr. Lukas Brunner von der Universität Hamburg auf Daten aus drei Jahrzehnten zurück und verglich dabei 176 Klimamodelle. Dabei zeigt sich, dass die Simulationen der globalen Temperaturmuster spürbar verlässlicher geworden sind. Die Schwachstelle hat sich verschoben: Nicht mehr die Klimamodelle und die zugrunde liegenden Rechenverfahren begrenzen die Aussagekraft – sondern die Daten, mit denen sie überprüft werden.

Klimamodelle erreichen heute erstaunliche Präzision

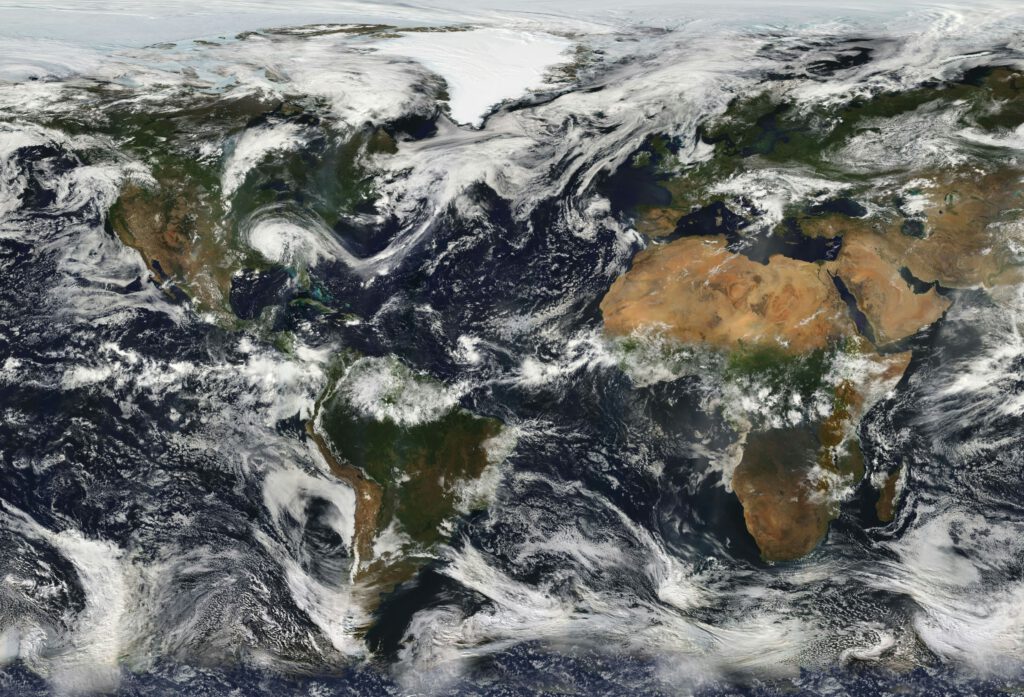

Der Fortschritt lässt sich gut an Zahlen ablesen. Während Klimamodelle in den 1990er-Jahren die beobachteten Temperaturmuster nur auf etwa einem Viertel der Erdoberfläche korrekt abbildeten, liegt dieser Anteil heute bei rund einem Drittel. Einzelne moderne Systeme erreichen sogar Werte von bis zu 60 Prozent Übereinstimmung mit realen Daten.

Ein genauerer Vergleich relativiert den vermeintlich großen Sprung. Schon in den 1990er-Jahren kam ein besonders leistungsfähiges Modell auf etwa 46 Prozent. Ein aktuelles Spitzenmodell erreicht rund 49 Prozent.

„Wenn man ein richtig gutes Modell aus den 1990er-Jahren nimmt, ist seine Leistung tatsächlich ähnlich wie die eines mittelguten heutigen Modells“, sagt Brunner.

Messdaten gewinnen massiv an Bedeutung

Mit der steigenden Genauigkeit der Modelle wird ein anderer Faktor immer wichtiger: die Qualität der Messdaten. Je nach Datensatz kann sich die Bewertung eines Modells um bis zu 40 Prozent unterscheiden.

Zwei Analysen desselben Modells können zu unterschiedlichen Einschätzungen kommen, obwohl die Berechnung identisch ist. Der Unterschied in der Interpretation der Ergebnisse entsteht durch die Datengrundlage. Das hat spürbare Folgen:

- Prognosen hängen stärker von der Qualität der Messnetze ab

- Regionen mit wenigen Daten bleiben schwieriger einzuschätzen

- Ergebnisse aus verschiedenen Studien lassen sich schlechter vergleichen

Klimamodelle reagieren sensibel auf Auswahl der Daten

Frühere Modelle reagierten weniger stark auf unterschiedliche Datensätze. Die Abweichungen lagen meist unter 20 Prozent. Moderne Systeme zeigen deutlich größere Unterschiede.

Das hängt eng mit der gestiegenen Präzision zusammen. Je genauer ein Modell arbeitet, desto stärker fallen Unterschiede zwischen Datensätzen ins Gewicht. Abweichungen, die früher kaum auffielen, werden heute sichtbar. Ein Wechsel der Referenzdaten kann deshalb die Bewertung eines Modells spürbar verändern.

Mehr Details bedeuten nicht automatisch bessere Ergebnisse

Moderne Klimamodelle rechnen heute viel feiner als früher. Statt grober Raster mit rund 100 Kilometern Abstand teilen sie die Erde in deutlich kleinere Abschnitte ein. Dadurch lassen sich regionale Unterschiede besser erkennen, etwa an Küsten oder in Gebirgen.

Doch mehr Details führen nicht automatisch zu besseren Ergebnissen. Im Schnitt verbessert sich die Genauigkeit nur leicht, etwa um 0,30 Grad pro 100 Kilometer feinere Auflösung.

In manchen Fällen wird das Ergebnis sogar ungenauer. Das passiert, wenn die Modelle zwar detaillierter rechnen, die zugrunde liegenden Prozesse aber nicht entsprechend angepasst sind. Ohne diese Feinabstimmung bringt zusätzliche Rechenleistung wenig.

„Eine höhere Auflösung kann notwendig sein, reicht aber nicht aus, um Modelle zu verbessern“, bestätigen die Autoren der Studie.

Neue Modelle zeigen Potenzial – und klare Grenzen

Besonders viel Aufmerksamkeit gilt den sogenannten Kilometer-Modellen. Sie arbeiten mit sehr hoher Detailtiefe und können Prozesse direkter abbilden. Erste Ergebnisse zeigen, dass sie Temperaturmuster auf bis zu 60 Prozent der Erdoberfläche korrekt simulieren.

Trotzdem ergibt sich ein gemischtes Bild. Viele dieser Modelle befinden sich noch in der Entwicklung und sind nicht vollständig abgestimmt. Einige schneiden daher schlechter ab als etablierte Systeme.

Zudem bleiben bekannte Schwachstellen bestehen. Im Nordatlantik treten weiterhin deutliche Abweichungen auf, ebenso in anderen Regionen mit komplexen Klimabedingungen.

Fortschritt entsteht durch Zusammenspiel mehrerer Faktoren

Die Entwicklung folgt keinem einfachen Muster. Mehr Rechenleistung allein führt nicht automatisch zu besseren Ergebnissen. Entscheidend ist das Zusammenspiel verschiedener Elemente:

- genauere physikalische Prozesse im Modell

- bessere Abstimmung an reale Beobachtungen

- dichtere und präzisere Messdaten

Erst wenn diese Faktoren zusammenkommen, verbessert sich die Qualität spürbar.

Kurz zusammengefasst:

- Klimamodelle sind heute deutlich präziser als früher und treffen Temperaturmuster auf bis zu 60 Prozent der Erdoberfläche korrekt.

- Die größte Unsicherheit entsteht inzwischen nicht mehr im Modell, sondern durch Unterschiede in den Messdaten, die Ergebnisse stark verändern können.

- Höhere Auflösung allein verbessert Prognosen nicht zuverlässig – entscheidend sind gute Daten, präzise Modellphysik und sorgfältige Abstimmung.

Übrigens: Während Klimamodelle immer präziser werden, zeigen Griechenlands antike Stätten wie Olympia und Delphi bereits ganz konkret, wie durch die Erderwärmung bedingte Hitze, Brände und Starkregen historische Orte in Risikozonen verwandeln. Mehr dazu in unserem Artikel.

Bild: © Unsplash