KI erkennt Bilder anders als wir – Warum das riskante Folgen haben kann

KI und menschliche Wahrnehmung unterscheiden sich deutlich: Eine neue Studie zeigt, wie anders Maschinen Objekte sehen und verarbeiten.

KI und Mensch sehen dieselben Bilder – doch ihre Wahrnehmung folgt völlig anderen Regeln. Das kann zu folgenschweren Irrtümern führen. © Vecteezy

Künstliche Intelligenz (KI) entscheidet längst mit, was wir hören, lesen oder kaufen – sie filtert Nachrichtenfeeds, sortiert Fotos nach Gesichtern und schlägt passende Produkte beim Online-Shopping vor. KI wirkt oft schnell, treffsicher und scheinbar intuitiv. Doch was passiert dabei im Hintergrund? Eine neue Studie hat untersucht, ob die Wahrnehmung der KI wirklich mit dem menschlichen Sehen vergleichbar ist – oder ob wir es mit einer völlig anderen Art des Verstehens zu tun haben.

KI erkennt das Was, nicht das Warum

Forscher des Max-Planck-Instituts für Kognitions- und Neurowissenschaften in Leipzig und der Justus-Liebig-Universität Gießen haben jetzt herausgefunden: Auch wenn KI auf den ersten Blick ähnlich funktioniert wie ein menschliches Gehirn, denkt sie offenbar völlig anders. „Unsere Ergebnisse zeigen einen wichtigen Unterschied“, sagt Florian Mahner, Erstautor der Studie.

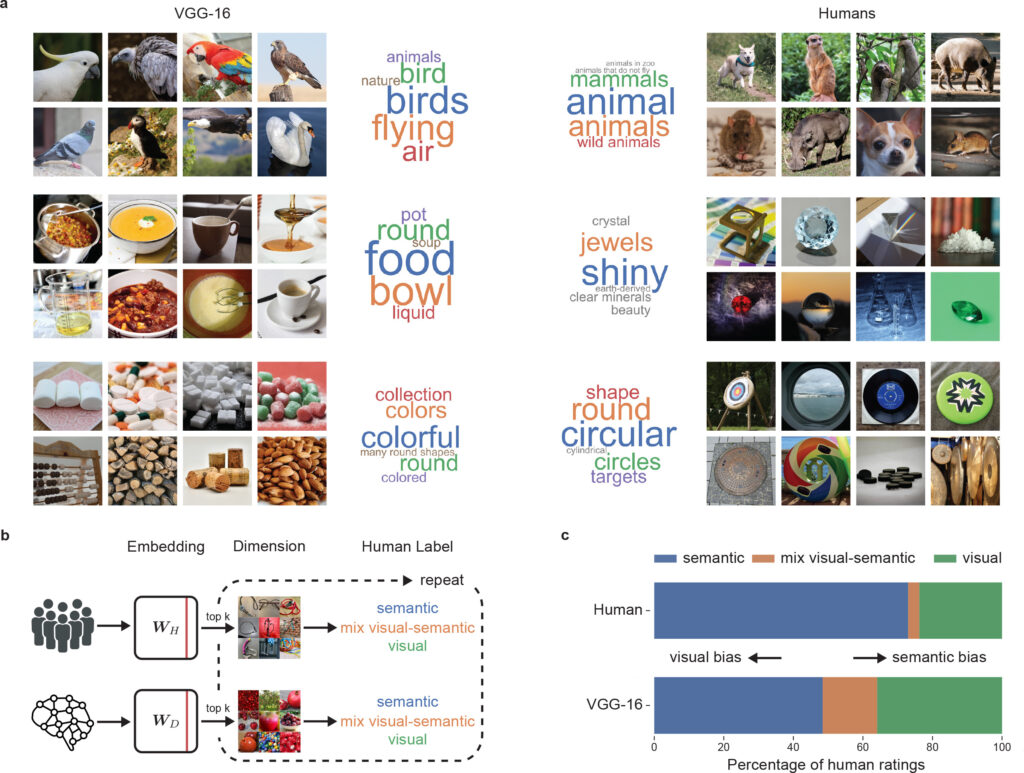

Während sich Menschen vor allem auf Dimensionen konzentrieren, die mit der Bedeutung zusammenhängen, verlassen sich KI-Modelle stärker auf visuelle Eigenschaften.

Florian Mahner

Eine Katze wird nicht nur an vier Beinen und Fell erkannt. Menschen wissen intuitiv, dass es sich um ein Tier handelt – oft verbunden mit eigenen Erinnerungen oder Erfahrungen. Dieses Hintergrundwissen prägt die Wahrnehmung und beeinflusst, wie Gesehenes verstanden und eingeordnet wird. KI hingegen arbeitet anders. Sie analysiert Formen, Farben und Muster. Eine Katze erkennt sie, weil sie ähnliche Pixelverteilungen schon einmal gesehen hat – nicht, weil sie versteht, was eine Katze ist.

Millionen Urteile machen Unterschiede sichtbar

Für ihre Untersuchung setzten die Forscher eine Methode ein, die menschliche und künstliche Bildwahrnehmung direkt vergleichbar macht:

- Menschen wählten aus drei Bildern das aus, das nicht zu den anderen passt („Odd-One-Out“-Prinzip).

- Über fünf Millionen solcher Urteile wurden ausgewertet.

- Die Bilder umfassten 1.854 Objekte – von Tieren bis zu abstrakten Formen.

- Die gleichen Bilder analysierten KI-Modelle mit tiefen neuronalen Netzen.

So ließ sich nachvollziehen, worauf Mensch und Maschine beim Erkennen achten – und wie unterschiedlich ihre Strategien dabei sind.

Das Besondere: Die Wissenschaftler untersuchten nicht nur, ob Mensch und KI das Gleiche erkannten. Sie wollten wissen, warum sie zu ihrer Entscheidung kamen. Dafür analysierten sie die sogenannten „Dimensionen“ – also Eigenschaften, auf die sich Mensch und Maschine beim Sehen konzentrieren.

Die Wahrnehmung der KI folgt anderen Regeln

Diese Dimensionen reichten von einfachen visuellen Merkmalen wie „weiß“, „rund“ oder „viereckig“ bis zu semantischen wie „lebendig“, „tierisch“ oder „gefährlich“. Dabei zeigte sich ein klares Muster: Menschen orientierten sich stark an der Bedeutung eines Objekts. KI dagegen achtete vor allem auf äußere Merkmale.

Selbst wenn die KI Objekte genauso zu erkennen scheint wie der Mensch, wendet sie oft grundlegend andere Strategien an.

Florian Mahner

Die Forscher nennen dieses Phänomen „visuelle Bevorzugung“. Das bedeutet: KI fokussiert sich auf das Sichtbare – aber lässt den Sinn dahinter oft außen vor.

Vertrauen in KI braucht Verständnis

Warum ist das wichtig? Ganz einfach: In vielen Bereichen unseres Lebens treffen KI-Systeme Entscheidungen, die Menschen direkt betreffen – ob beim Bewerbungsverfahren, bei Diagnosen oder beim autonomen Fahren. Wer aber annimmt, dass die Maschine die Welt genauso „versteht“ wie wir, täuscht sich.

„Dieses Wissen kann uns nicht nur helfen, die KI-Technologie zu verbessern, sondern liefert auch wertvolle Einblicke in die menschliche Kognition.“ sagt Prof. Dr. Martin Hebart, Mitautor der Studie.

„Unsere Forschung bietet eine klare und interpretierbare Methode zur Untersuchung dieser Unterschiede“, so Hebart weiter. Diese Methode hilft nicht nur dabei, KI-Systeme besser zu gestalten. Sie zeigt auch, wie das menschliche Denken funktioniert. Denn im direkten Vergleich mit der Maschine wird deutlich, was den Menschen besonders macht: Kontext, Bedeutung und das große Ganze.

Kurz zusammengefasst:

- Künstliche Intelligenz erkennt Objekte zwar ähnlich wie Menschen, verlässt sich dabei aber vor allem auf visuelle Merkmale wie Form oder Farbe.

- Menschen beziehen beim Sehen Bedeutung und Kontext mit ein – genau hier unterscheidet sich die Wahrnehmung der KI grundlegend von der menschlichen.

- Die Studie des Max-Planck-Instituts zeigt, dass KI anders „denkt“ und entscheidet – das beeinflusst, wie sehr wir ihren Einschätzungen im Alltag vertrauen können.

Übrigens: Während KI die Welt ganz anders wahrnimmt als wir, rechnen Tech-Konzerne bereits mit dem nächsten Sprung – zur echten Superintelligenz. Was passiert, wenn Maschinen bald klüger handeln als Nobelpreisträger – mehr dazu in unserem Artikel.

Bild: © Vecteezy