Täuschend echt: KI fälscht Röntgenbilder – selbst Radiologen fallen darauf herein

KI-Röntgenbilder wirken so echt, dass sie selbst Radiologen hinters Licht führen. Das erhöht Risiken für Diagnosen, Klinik-IT und Betrugsfälle.

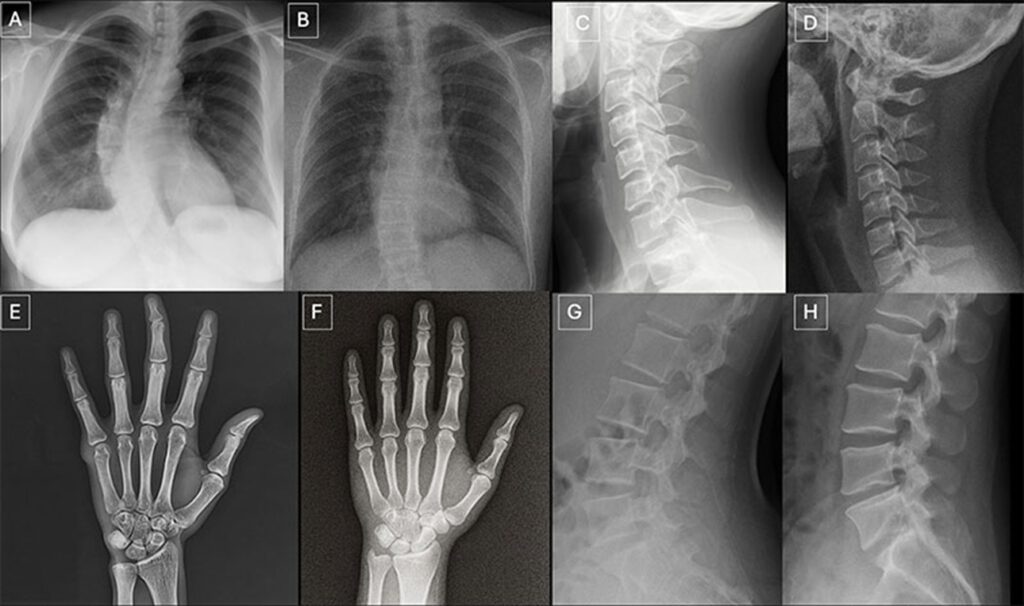

Im Vergleich sind jeweils links die echten und rechts die von GPT-4o erzeugten Röntgenbilder zu sehen – von Brustkorb, Halswirbelsäule, Hand und Lendenwirbelsäule. © RSNA 2026

Bilder verlieren ihren Status als ultimatives Beweismittel. Seit künstliche Intelligenz täuschend echte Inhalte erzeugt, wird es immer schwerer, Wahrheit und Manipulation auseinanderzuhalten. Das betrifft längst nicht mehr nur soziale Netzwerke oder politische Debatten, sondern auch Versicherungen, Gerichte und jetzt sogar die Medizin. Selbst Röntgenbilder, die als besonders verlässliche Grundlage für Diagnosen gelten, können inzwischen so überzeugend gefälscht werden, dass Fachleute ins Zweifeln geraten. Brisant ist das vor allem dort, wo solche Aufnahmen über Geld, Schuld, Behandlung oder juristische Ansprüche mitentscheiden.

Eine aktuelle Studie im Fachjournal Radiology, veröffentlicht von der Radiological Society of North America, zeigt, wie groß das Problem bereits ist. Künstlich generierte Bilder erreichen eine Qualität, die die Grenze zwischen echt und künstlich verschwimmen lässt. Gefälschte Röntgenbilder wirken so überzeugend, dass selbst erfahrene Radiologen häufig danebenliegen.

Gefälschte Röntgenbilder – KI verunsichert Ärzte

An der Untersuchung nahmen 17 Radiologen teil. Sie arbeiteten in 12 Einrichtungen auf drei Kontinenten. Ihre Erfahrung reichte von wenigen Jahren bis zu vier Jahrzehnten. Insgesamt bewerteten sie 264 Aufnahmen. Die Hälfte war echt, die andere Hälfte wurde von KI erzeugt.

Die Ergebnisse fallen deutlich aus:

- Ohne Hinweis auf mögliche Fälschungen erkannten Radiologen künstliche Bilder nur in 41 Prozent der Fälle

- Mit Vorwarnung stieg die Trefferquote auf 75 Prozent

- Einzelne Ergebnisse schwankten stark zwischen 58 und 92 Prozent

- Erfahrung spielte keine entscheidende Rolle bei der Erkennung

Diese Zahlen zeigen, wie stark der Kontext wirkt. Wer nicht mit Manipulation rechnet, übersieht sie oft.

Ohne Vorwarnung sinkt die Trefferquote drastisch

Die Studie arbeitete mit zwei getrennten Bilddatensätzen. Einer enthielt Aufnahmen aus verschiedenen Körperregionen, erstellt unter anderem mit GPT-4o. Der zweite konzentrierte sich auf Röntgenbilder des Brustkorbs. Diese wurden zur Hälfte mit dem offenen Modell RoentGen erzeugt.

Auch hier zeigt sich ein ähnliches Bild. Radiologen erreichten bei den Brustkorb-Aufnahmen Trefferquoten zwischen 62 und 78 Prozent. Die Qualität der künstlichen Bilder bleibt also konstant hoch – unabhängig von der Körperregion.

Auch KI-Systeme erkennen Fälschungen oft nicht sicher

Neben Ärzten wurden auch moderne KI-Systeme getestet. Darunter GPT-4o, GPT-5, Gemini 2.5 Pro und Llama 4 Maverick. Sie sollten echte und künstliche Bilder unterscheiden.

Die Ergebnisse liegen nahe an denen der Menschen:

- Trefferquoten zwischen 57 und 85 Prozent bei ChatGPT-Bildern

- Werte zwischen 52 und 89 Prozent bei RoentGen-Aufnahmen

- Selbst das erzeugende System erkannte nicht alle Fälschungen

Damit entsteht eine neue Situation. KI kann realistische Bilder erzeugen, scheitert aber teilweise an ihrer eigenen Täuschung.

Typische Details verraten künstliche Bilder subtil

Trotz der hohen Qualität gibt es Hinweise auf künstliche Herkunft. Sie sind jedoch oft schwer zu erkennen. Künstliche Bilder wirken häufig zu „glatt“. Strukturen erscheinen gleichmäßig.

Studienautor Mickael Tordjman beschreibt das so: „Deepfake-Bilder wirken oft zu perfekt.“ Typische Auffälligkeiten sind:

- ungewöhnlich glatte Knochen

- sehr gerade Wirbelsäulen

- symmetrische Lungenstrukturen

- gleichmäßige Gefäßmuster

- auffällig saubere Brüche

Solche Details fallen jedoch nur auf, wenn gezielt danach gesucht wird.

Risiken reichen von Betrug bis zu Klinik-Sicherheitsproblemen

Besonders heikel ist der Einsatz in rechtlichen Auseinandersetzungen. „Ein erfundener Knochenbruch könnte von einem echten kaum zu unterscheiden sein“, warnt Tordjman. Davon könnten etwa Menschen profitieren, die Versicherungen täuschen, Ansprüche in Gerichtsverfahren untermauern oder medizinische Unterlagen bewusst manipulieren wollen.

Hinzu kommen Risiken für die IT-Sicherheit. Manipulierte Bilder könnten in Kliniksysteme eingeschleust werden. Das würde Diagnosen verfälschen und Abläufe stören. Tordjman spricht von einem „erheblichen Cyber-Sicherheitsrisiko“. Auch für Angreifer, die elektronische Patientenakten verändern oder gezielt Chaos im Klinikbetrieb auslösen wollen, wären solche Fälschungen potenziell nützlich.

Im schlimmsten Fall leidet das Vertrauen in digitale Patientenakten. Darauf baut moderne Medizin jedoch zunehmend auf.

Neue Schutzmechanismen sollen Bilder besser absichern

Experten arbeiten bereits an Lösungen. Ziel ist es, die Herkunft von Bildern eindeutig nachweisbar zu machen. Diskutiert werden verschiedene Ansätze.

Dazu gehören unsichtbare Wasserzeichen, die direkt in die Bilddaten eingebettet werden. Auch digitale Signaturen könnten helfen. Sie verknüpfen jede Aufnahme eindeutig mit dem Zeitpunkt der Erstellung und dem zuständigen Personal.

Parallel entstehen Trainingsprogramme. Sie sollen Radiologen für typische Muster künstlicher Bilder sensibilisieren. Denn die Technik entwickelt sich schnell weiter.

Entwicklung dürfte sich weiter beschleunigen

Die aktuelle Generation künstlicher Bilder markiert erst den Anfang. Künftig könnten auch komplexe 3D-Aufnahmen wie CT oder MRT täuschend echt erzeugt werden. „Wir sehen wahrscheinlich nur die Spitze des Eisbergs“, sagt Tordjman.

Damit wächst der Druck auf Kliniken und Gesundheitssysteme. Sie müssen lernen, mit einer neuen Realität umzugehen. Bilder allein reichen nicht mehr als Beweis. Ihre Herkunft wird entscheidend.

Kurz zusammengefasst:

- KI kann heute Röntgenbilder erzeugen, die so echt wirken, dass selbst Radiologen sie oft nicht sicher von echten Aufnahmen unterscheiden können.

- Das ist riskant, weil gefälschte Bilder Diagnosen beeinflussen, Patientenakten verfälschen und bei Versicherungen oder vor Gericht missbraucht werden könnten.

- Kliniken und Fachleute brauchen deshalb neue Schutzmechanismen wie Wasserzeichen, digitale Signaturen und gezieltes Training, damit die Echtheit medizinischer Bilder besser geprüft werden kann.

Übrigens: Wenn KI schon täuschend echte Röntgenbilder erzeugen kann, stellt sich umso dringlicher die nächste Frage: Wie neutral sind dieselben Systeme eigentlich, wenn es um politische Urteile geht? Eine neue Auswertung des Wahl-O-Mat deutet bei ChatGPT und anderen Modellen auf eine erkennbare Tendenz hin – mehr dazu in unserem Artikel.

Bild: © RSNA 2026