Google bringt Delfine zum Sprechen und macht ihr rätselhaftes Summen verständlich

Google bringt ein Sprachmodell für Delfine an den Start: Die KI erkennt Muster in ihrer Kommunikation und wertet diese aus.

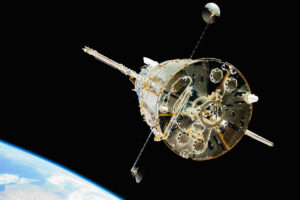

Das Wild Dolphin Project untersucht schon seit 40 Jahren eine feste Gruppe Zügeldelfine, um ihre Kommunikation besser zu verstehen. © Wikimedia

Wissenschaftler versuchen seit Jahrzehnten, die Laute von Delfinen zu entschlüsseln – bisher mit begrenztem Erfolg. Nun sollen sie die Unterstützung eines großen Sprachmodells (LLM) erhalten: DolphinGemma heißt eine von Google entwickelte KI, die dabei helfen soll, Muster in der Kommunikation der Delfine zu erkennen und so ihre Sprache besser zu verstehen.

Gemeinsam mit der Wild Dolphin Project-Initiative (WDP) und dem Georgia Institute of Technology hat Google ein System entwickelt, das Delfinlaute aufnimmt, analysiert und sogar vorhersagen kann.

DolphinGemma: KI erhält Zugriff auf umfassenden „Wortschatz“ der Delfine

Seit 1985 erforscht das WDP eine feste Gruppe wilder Zügeldelfine auf den Bahamas. Aufgrund ihrer markanten Flecken und ihres Verbreitungsgebiets werden sie auch Atlantische Fleckendelfine genannt. Die Forscher filmen und belauschen die Tiere unter Wasser. So können sie jedem Laut, den die Tiere von sich geben, ein konkretes Verhalten zuordnen. Ähnliches haben Forscher bereits bei Bonobos gemacht, die scheinbar eine ähnlich komplexe Sprache wie die des Menschen aufweisen.

Die Wissenschaftler haben bei den Delfinen einige typische Geräusche beobachtet

- Mütter und Kälber nutzen Signaturpfiffe, die wie Namen funktionieren, um einander zu rufen

- In Kämpfen sind häufig Laute zu hören, die von den Wissenschaftlern als „Burst-Pulse-Krächzer“ bezeichnet werden

- Bei der Balz oder beim Verfolgen von Haien kommt oft ein klickartiges „Summen“ zum Einsatz

Damit diese Fülle an Tönen nicht nur archiviert, sondern auch ausgewertet werden kann, nutzt Google die SoundStream-Technologie. Anschließend verarbeitet DolphinGemma diese Geräusche mit einem Modell, das auf Reihenfolgen trainiert ist. Ähnlich wie ein Sprachmodell für Menschen berechnet die KI, wie die nächsten Laute wahrscheinlich klingen werden.

Pixel-Smartphones übernehmen die ganze Rechenarbeit

Das Modell läuft direkt auf Pixel-Smartphones von Google, die das Forschungsteam im Ozean nutzt. So kann DolphinGemma vor Ort arbeiten – ohne große Rechenzentren oder komplizierte Hardware. Die KI hilft, typische Tonmuster zu erkennen und erleichtert so die Analyse von Delfin-Gesprächen.

Zusätzlich setzen die Forscher auf ein zweites System: CHAT – eine Unterwassertechnik, die eine einfache Kommunikation zwischen Mensch und Delfin ermöglichen soll. CHAT erzeugt künstliche Pfeiflaute, die jeweils einem Objekt zugeordnet sind, etwa einem Büschel Seegras oder einem Tuch.

Wenn ein Delfin das künstliche Pfeifen imitiert, erkennt CHAT dies und meldet dem Forscher über Kopfhörer, welchen Gegenstand das Tier „gefordert“ hat. Der Mensch kann dann sofort reagieren. Ein Google Pixel 6 wertet die Laute in Echtzeit aus.

Forscher bekommen im Sommer freien Zugriff auf die KI

Google plant, das Modell im Sommer der Forschung frei zugänglich zu machen. Auch wenn DolphinGemma auf Zügeldelfine trainiert wurde, soll es mit Anpassungen auch bei anderen Delfinarten einsetzbar sein. Dann könnten Forscher weltweit ihre eigenen Tonaufnahmen analysieren und schneller neue Erkenntnisse gewinnen.

So könnte die Kombination aus langjähriger Forschung durch das WDP und den technischen Möglichkeiten von Google die Mensch-Tier-Kommunikation einen Schritt weiter bringen.

Kurz zusammengefasst:

- Google hat mit DolphinGemma eine künstliche Intelligenz (KI) entwickelt, die die Laute der Delfine analysiert und typische Muster in ihrer Kommunikation erkennt.

- Die KI läuft auf Pixel-Smartphones und hilft Forschern, Tierlaute besser zuzuordnen.

- Über das Zusatzsystem CHAT können Delfine sogar auf einfache Weise mit Menschen kommunizieren.

Übrigens: Nicht nur Delfine erhalten durch KI eine Stimme – auch Schlaganfall-Patienten können dank neuer Technologie wieder sprechen. Wie ein System Hirnsignale in individuelle Sprache übersetzt, mehr dazu in unserem Artikel.

Bild: © Wayne Hoggard NOAA/NMFS/SEFSC via Wikimedia unter Public Domain