Stanford entwickelt neue Mixed-Reality-Brille – So echt war virtuelle Welt noch nie

Forscher der Standford University basteln an einer neuen Mixed-Reality-Brille, die 3D-Bilder so täuschend echt projiziert, als wären sie wirklich da.

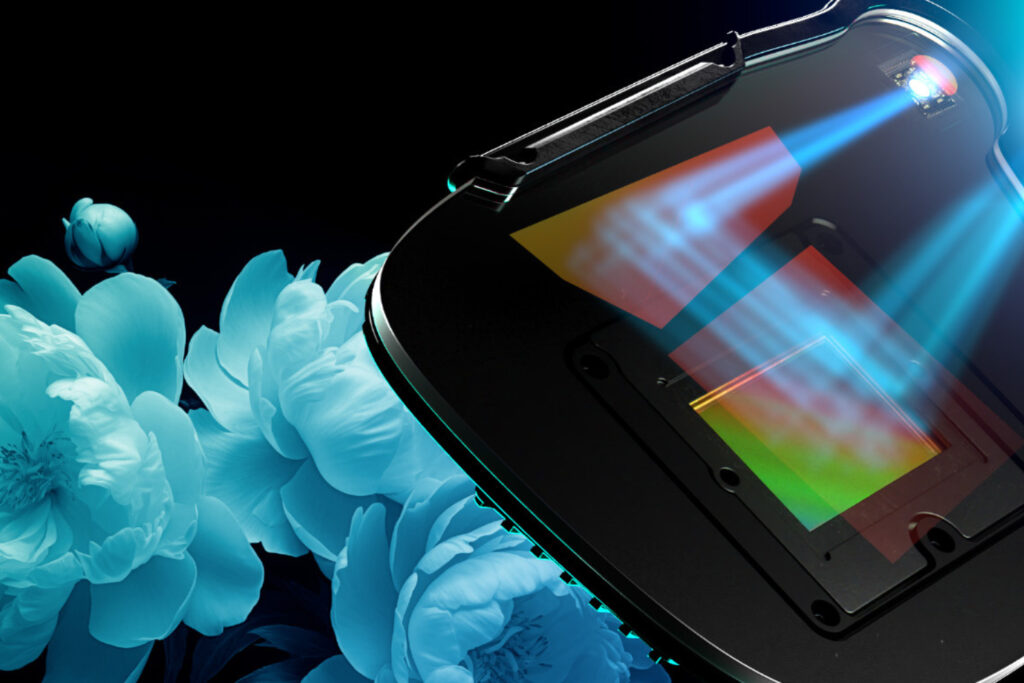

Die von der Stanford University entwickelte Brille kombiniert Holografie, Lichtwellenleiter und KI in einem nur drei Millimeter dünnen Displaysystem. © Stanford University

Kaum dicker als eine normale Lesebrille – doch was die Mixed-Reality-Brille der Stanford University leistet, könnte unseren Alltag grundlegend verändern. Erstmals gelingt es, virtuelle Bilder so nahtlos in die echte Umgebung einzubetten, dass sie mit bloßem Auge kaum noch von der Realität zu unterscheiden sind – ohne klobiges Headset, ohne Augenermüdung, ohne technische Kompromisse.

Eine aktuelle Studie zeigt, wie Holografie, spezielle Lichtwellenleiter und Künstliche Intelligenz erstmals so kompakt kombiniert wurden, dass ein seriennaher Einsatz realistischer denn je scheint.

Mixed-Reality-Brille zeigt stabile Bilder trotz Bewegung

Der Prototyp misst gerade einmal drei Millimeter in der Tiefe – etwa so dünn wie ein Brillenglas. Das gelingt durch drei zentrale Bauteile:

- einen Lichtwellenleiter mit nur 0,6 Millimetern Dicke

- ein holografisches Objektiv, das zusätzliche zwei Millimeter misst

- sowie einen beweglichen Mikrospiegel, der den Lichtstrahl lenkt

Die Kombination erzeugt ein stabiles, brillantes Bild – auch dann, wenn sich der Blickwinkel leicht verändert oder die Brille auf der Nase verrutscht. Frühere Systeme hatten hier deutliche Schwächen: Schon kleine Bewegungen ließen virtuelle Objekte verschwimmen oder ganz verschwinden.

Größeres Sichtfeld durch synthetische Lichtöffnung

Möglich wird das durch eine sogenannte synthetische Apertur. Dabei lenkt ein Mikrospiegel den Laserstrahl aus mehreren Winkeln über den Wellenleiter. Diese digitalen Lichtquellen interferieren so miteinander, dass ein zusammenhängendes 3D-Bild entsteht – aus nahezu jeder Blickposition.

Zentraler Vorteil:

- Das Eyebox-Volumen – also der Bereich, aus dem das Bild sichtbar bleibt – misst 9 × 8 Millimeter. Das ist rund 100-mal größer als bei klassischen Systemen mit nur einem statischen Lichtweg.

- Das Sichtfeld erreicht 38 Grad in der Diagonale. Damit lassen sich virtuelle Objekte frei im Raum platzieren, ohne dass das Sichtfeld künstlich begrenzt wirkt.

Sehschärfe und Farben auf Augenhöhe mit der Realität

Die Auflösung der Projektion liegt bei 1,2 Bogenminuten – das entspricht fast der Sehschärfe des menschlichen Auges (1,0 oder 20/20 Vision). Details erscheinen gestochen scharf, selbst bei filigranen Strukturen. Das ist besonders bei medizinischen Anwendungen oder im Maschinenbau von großem Wert.

Auch die Farbdarstellung erfüllt hohe Ansprüche. Drei exakt gesteuerte Wellenlängen – Rot (638 nm), Grün (520 nm) und Blau (460 nm) – werden über sogenannte Volumen-Bragg-Gitter in das System eingespeist. Diese Gitter koppeln das Licht winkelgenau ein und sorgen so für satte, realistische Farben.

KI berechnet Lichtwellen – schneller und sparsamer

Ein zentrales Element ist die Software. Statt auf klassische Deep-Learning-Modelle setzt das Team auf ein implizites neuronales Netzwerk. Dieses simuliert, wie sich Licht innerhalb des Wellenleiters verhält – und das deutlich effizienter als bisherige Modelle.

Die Vorteile:

- Die Trainingszeit sinkt von mehreren Tagen auf wenige Stunden.

- Die Modelle benötigen weniger Daten, erzielen aber eine höhere Genauigkeit.

- Sie verallgemeinern besser – das heißt, sie liefern auch bei neuen Blickwinkeln stabile Bildqualität.

Die Technik wurde bereits experimentell überprüft: Selbst bei Bewegungen entlang der optischen Achse blieb die Darstellung konstant, auch außerhalb der ursprünglich trainierten Positionen.

Mixed-Reality-Brille: Anwendungen in Alltag und Klinik

Für das Forscherteam steht fest: Entscheidend ist nicht nur die technische Raffinesse, sondern vor allem der praktische Nutzen. „Ein visueller Turing-Test bedeutet idealerweise, dass man nicht unterscheiden kann, ob man ein echtes Objekt sieht oder ein digitales Bild“, erklärt Suyeon Choi, der Erstautor der Studie.

Künftig könnten Mixed-Reality-Brillen:

- in der Chirurgie eingesetzt werden, um dreidimensionale Organdarstellungen direkt ins Blickfeld zu bringen

- in der Ausbildung neue Formen des Lernens ermöglichen

- in der Architektur virtuelle Baukörper in reale Räume projizieren

- oder bei Sehbeeinträchtigung unterstützend wirken, etwa durch vergrößerte, kontrastreiche Darstellungen

Noch handelt es sich um einen Prototyp. Doch Gordon Wetzstein, Professor für Elektrotechnik und Mitautor der Studie, bezeichnet die Brille als Durchbruch:

Holographie bietet Möglichkeiten, die mit keiner anderen Display-Technologie erreichbar sind – und das in einem deutlich kleineren Format als alles, was derzeit auf dem Markt ist.

Kurz zusammengefasst:

- Die neue Mixed-Reality-Brille der Stanford University nutzt Holografie und misst nur drei Millimeter – sie erzeugt realistische 3D-Bilder bei voller Farbdarstellung und bleibt auch bei Kopfbewegung stabil.

- Ein synthetisches Lichtsystem mit Mikrospiegeln vergrößert das Sichtfeld auf 38 Grad und das Eyebox-Volumen auf 9 × 8 mm² – fast hundertmal größer als bei bisherigen Systemen.

- Eine KI-basierte Lichtsteuerung senkt die Rechenzeit deutlich und ermöglicht präzise Darstellungen mit nahezu menschlicher Sehschärfe – selbst bei neuen Blickwinkeln oder sich bewegenden Nutzern.

Übrigens: Wer schlecht sieht oder hört, riskiert mehr als nur Alltagsprobleme – laut einer aktuellen Lancet-Studie zählt unbehandelter Sinnesverlust jetzt offiziell zu den vermeidbaren Risikofaktoren für Demenz. Wie Brillen und Hörgeräte helfen können, das Gehirn fit zu halten – mehr dazu in unserem Artikel.

Bild: © Nathan Matsuda / Stanford University