Schwimmendes KI-Rechenzentrum – Wind liefert Strom, Ozean die Kühlung

Ein schwimmendes KI-Rechenzentrum nutzt Offshore-Windstrom und Meerwasser zur Kühlung der Server. Erste Anlagen sollen ab 2026 vor Europas Küsten entstehen.

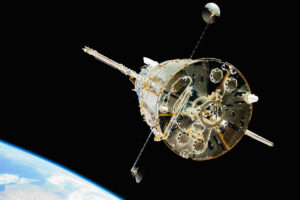

In der schwimmenden Offshore-Windplattform befindet sich ein KI-taugliches Rechenzentrum, das den erzeugten Windstrom direkt vor Ort nutzt. © Aikido Technologies

Künstliche Intelligenz verändert derzeit ganze Branchen. Doch hinter den Chatbots, Bildgeneratoren und Analyseprogrammen steht eine oft übersehene Infrastruktur: riesige Rechenzentren. Sie verbrauchen enorme Mengen Strom und benötigen große Flächen sowie leistungsstarke Kühlsysteme. In vielen Regionen geraten solche Projekte bereits an Grenzen. Stromnetze sind ausgelastet, Wasser wird knapp, Bauflächen fehlen.

Ingenieure suchen deshalb nach neuen Standorten für die digitale Infrastruktur. Ein Ansatz verlagert Rechenleistung dorthin, wo Energie reichlich vorhanden ist: aufs Meer. Dort könnten Server, Windkraftanlagen und Batteriespeicher direkt nebeneinander arbeiten. Die Idee hinter diesem Konzept: Ein KI-Rechenzentrum im Meer produziert seinen Strom selbst und nutzt das umgebende Wasser zur Kühlung der Anlagen.

Plattform verbindet Windkraft und Server direkt offshore

Das Konzept stammt von dem Offshore-Infrastrukturunternehmen Aikido Technologies. Die Plattform kombiniert mehrere Technologien in einer einzigen schwimmenden Anlage: Windturbine, Batteriespeicher und Rechenzentrum.

Über den Serverräumen ragt eine große Offshore-Windturbine. Sie liefert den Strom für die Rechner. Ein integrierter Batteriespeicher gleicht Schwankungen aus, wenn der Wind nachlässt.

Die Entwickler planen jede Plattform als eigenständige Einheit. Mehrere dieser Module können zu großen Rechenclustern verbunden werden.

Die wichtigsten technischen Eckdaten:

- 10 bis 12 Megawatt Rechenleistung pro Plattform

Das entspricht etwa der Leistung eines kleineren Rechenzentrums. - 15 bis über 18 Megawatt Windleistung pro Anlage

Eine Offshore-Windturbine versorgt die Server direkt mit Strom. - 30 Megawatt bis über 1 Gigawatt Gesamtleistung pro Offshore-Anlage

Mehrere Plattformen können zusammen große KI-Infrastrukturen bilden.

Diese Kombination erlaubt es, digitale Infrastruktur dort zu betreiben, wo Energie entsteht – und nicht dort, wo bereits Engpässe bestehen.

Meerwasser übernimmt eine entscheidende Aufgabe

Ein großes Problem moderner Rechenzentren ist die Kühlung. Tausende Server erzeugen kontinuierlich Wärme. Klassische Anlagen benötigen dafür große Kühlsysteme und viel Wasser.

Auf See entsteht ein anderer Ansatz. Die Wärme der Server gelangt über die Stahlstruktur der Plattform direkt an das Meerwasser. Der Ozean fungiert dabei wie eine natürliche Kühlung.

Ein wichtiger Maßstab für Rechenzentren ist der Energieverbrauch der gesamten Anlage. Fachleute sprechen von Power Usage Effectiveness (PUE). Der Wert beschreibt, wie viel Strom neben den eigentlichen Servern noch für Kühlung, Technik und Betrieb benötigt wird.

Bei der schwimmenden Plattform soll dieser Wert unter 1,08 liegen. Das bedeutet: Fast der gesamte Strom fließt direkt in die Rechenleistung. In vielen heutigen Rechenzentren liegt der Wert deutlich höher – meist zwischen 1,2 und 1,5.

Auch die Wärme bleibt laut Konzept stark begrenzt. Das Meerwasser nimmt sie unmittelbar auf. Der Temperaturanstieg soll sich auf einen kleinen Bereich von wenigen Metern rund um die Plattform beschränken.

Offshore-Standorte umgehen mehrere Infrastrukturprobleme

Der Standort auf dem Meer bringt mehrere Vorteile. In vielen Regionen stoßen neue Rechenzentren auf Widerstand. Strombedarf, Wasserverbrauch und Flächenbedarf führen zu Konflikten mit Kommunen und Energieversorgern.

Auf See entstehen diese Engpässe deutlich seltener. Windkraft liefert Energie direkt vor Ort. Kühlung übernimmt das Meer. Bauflächen stehen ebenfalls zur Verfügung.

Die Plattformen sollen in einem Radius von bis zu 200 Meilen – rund 320 Kilometer – vor der Küste arbeiten. Gleichzeitig bleibt die Datenverbindung schnell. Die Latenzzeit liegt laut Konzept unter 10 Millisekunden.

Dadurch können solche Anlagen relativ nah an großen Städten betrieben werden, ohne deren Infrastruktur zusätzlich zu belasten.

Modulares System beschleunigt den Bau deutlich

Die Plattform nutzt eine Bauweise, die aus der Offshore-Industrie bekannt ist. Halbtauchende Plattformen werden seit Jahrzehnten bei Öl- und Gasprojekten eingesetzt.

Aikido überträgt dieses Prinzip auf Rechenzentren. Die Anlage besteht aus mehreren vorgefertigten Modulen. Diese Bauteile entstehen bereits in Fabriken und werden anschließend auf See zusammengesetzt.

Nach Angaben des Unternehmens lässt sich eine solche Plattform bis zu zehnmal schneller montieren als klassische Offshore-Strukturen. Auch Wartung und Betrieb orientieren sich an bestehenden Offshore-Techniken. Schiffe aus der Windkraft- und Ölindustrie können die Anlagen erreichen und Serviceteams an Bord bringen.

Erste Anlage entsteht bereits in Norwegen

Ein Demonstrationsprojekt befindet sich derzeit in Entwicklung. Die erste Plattform soll 2026 vor der Küste Norwegens installiert werden.

Das Unternehmen arbeitet im NVIDIA-Inception-Programm, einem Netzwerk für KI-Technologien. Erste Interessenten für solche Offshore-Rechenzentren kommen aus dem Bereich KI-Inferenz, also der schnellen Verarbeitung großer Datenmengen.

Das erste kommerzielle Projekt ist bereits geplant. Eine Anlage vor Großbritannien könnte 2028 in Betrieb gehen. Ein konkreter Standort wurde bereits identifiziert.

Weitere Zahlen aus dem Konzept:

- Über 50 Gigawatt mögliche Offshore-Standorte weltweit

Viele dieser Flächen sind bereits für schwimmende Windkraft vorgesehen. - Lokale Bau- und Wartungsjobs in Küstenregionen

Bau, Betrieb und Wartung erfordern spezialisierte Offshore-Technik. - Geringe Sichtbarkeit von Land aus

Die Plattformen liegen weit genug vor der Küste.

Aikido-Chef Sam Kanner beschreibt die Idee laut einer Mitteilung mit einem historischen Vergleich: „Bevor wir ins All gehen, sollten wir aufs Meer hinausgehen.“ Weiter sagt er: „Die ersten Unternehmen der Offshore-Ölindustrie nutzten vor mehr als 40 Jahren Tiefsee-Ressourcen und profitierten enorm davon.“

Mit schwimmenden Rechenzentren könnte sich eine ähnliche Entwicklung für die digitale Infrastruktur abzeichnen. Die Kombination aus Windkraft, Batteriespeicher und Servern verlagert einen Teil der wachsenden KI-Infrastruktur dorthin, wo Energie und Kühlung reichlich vorhanden sind: auf die offene See.

Kurz zusammengefasst:

- KI-Rechenzentren brauchen immer mehr Strom und Kühlung. Ein neues Konzept verlegt Server deshalb aufs Meer: Windturbinen liefern Energie, Meerwasser kühlt die Anlagen direkt.

- Eine schwimmende Plattform soll 10–12 Megawatt Rechenleistung aufnehmen, mehrere Anlagen können Offshore-Rechenzentren mit bis zu über 1 Gigawatt Leistung bilden – bei sehr hoher Energieeffizienz (PUE unter 1,08).

- Ein erster Prototyp ist für 2026 vor Norwegen geplant, das erste kommerzielle Projekt könnte 2028 vor Großbritannien starten; weltweit wären über 50 Gigawatt solcher Offshore-Standorte möglich.

Übrigens: Während neue Plattformen KI-Rechenzentren aufs Meer verlagern, geht China noch einen Schritt weiter – und versenkt Server direkt auf dem Meeresboden, gekühlt vom Ozean. Mehr dazu in unserem Artikel.

Bild: © Aikido Technologies